Оцінка швидкодії застосування моделей-класифікаторів даних аерозйомки в умовах обмежених ресурсів

DOI:

https://doi.org/10.15587/2706-5448.2025.323322Ключові слова:

безпілотні літальні апарати, дані аерозйомки, нейромережі-класифікатори, машинне навчання, обмежені обчислювальні ресурсиАнотація

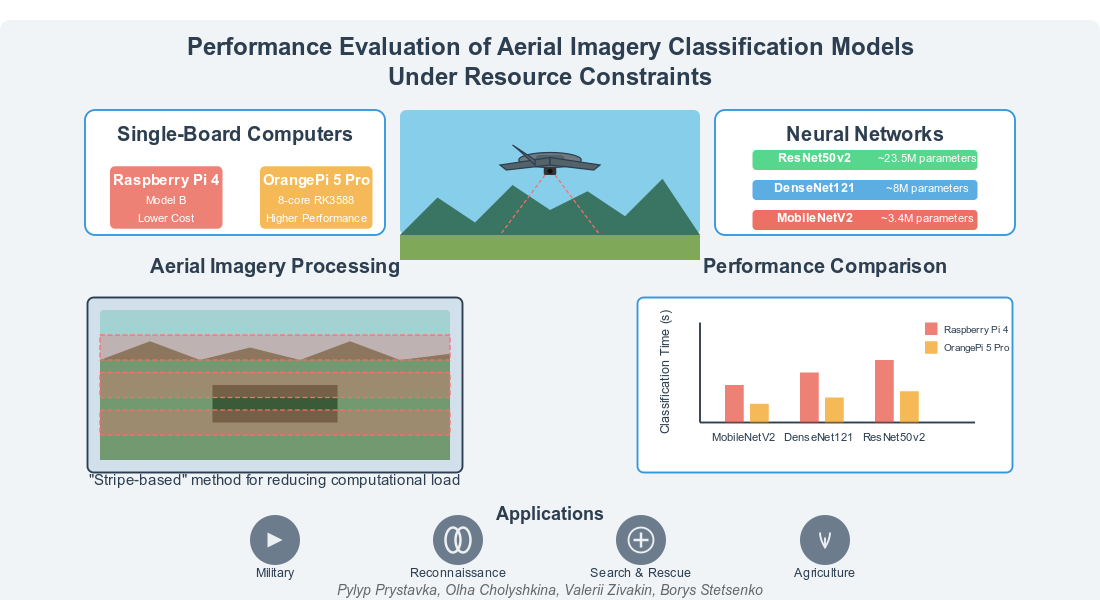

Об’єктом дослідження є процес обробки даних аерофотозйомки в умовах обмежених обчислювальних ресурсів, зокрема на одноплатних комп’ютерах, що встановлюються на борту безпілотних літальних апаратів (БПЛА) за використанням моделей класифікації.

Одним із найбільш проблемних місць є адаптація моделей класифікації до змін масштабу та перспективних спотворень, які виникають під час маневрування БПЛА. Крім того, висока обчислювальна складність традиційних методів, таких як ковзне вікно, значно обмежує можливості використання на пристроях з обмеженими ресурсами.

У ході дослідження використовувалися сучасні нейромережі-класифікатори, такі як ResNet50v2, DenseNet121 і MobileNetV2, які було навчено на спеціалізованому наборі даних аерофотозйомки.

Проведено експеримент по застосуванню запропонованих нейромереж-класифікаторів на платформах Raspberry Pi 4 Model B та OrangePi 5 Pro з обмеженими обчислювальними потужностями, що імітують обмежені ресурси систем БПЛА. Для оптимізації роботи запропоновано обробляти потокове відео «по-смугово», що забезпечує баланс швидкодії обробки та кількості обробленої інформації повітряного спостереження. При цьому отримано оцінки часу застосування різних типів мереж-класифікаторів на одноплатних комп’ютерах, що можуть бути розміщені на борту БПЛА.

Завдяки цьому забезпечується можливість оперативної обробки даних аерофотозйомки в реальному часі. У порівнянні з традиційними підходами, запропоновані рішення забезпечують переваги у вигляді зниження енергоспоживання, прискорення обчислень і підвищення точності. Це робить результати дослідження перспективними для впровадження в різних сферах, таких як військові операції, розвідка, пошуково-рятувальні місії та агротехнології.

Посилання

- Chyrkov, A., Prystavka, P.; Hu, Z., Petoukhov, S., Dychka, I., He, M. (Eds.) (2018). Suspicious Object Search in Airborne Camera Video Stream. ICCSEEA 2018. Advances in Computer Science for Engineering and Education, 340–348. https://doi.org/10.1007/978-3-319-91008-6_34

- Prystavka, P., Shevchenko, A., Rokitianska, I. (2024). Comparative Analysis of Detector-Tracker Architecture for Object Tracking Based on SBC for UAV. 2024 IEEE 7th International Conference on Actual Problems of Unmanned Aerial Vehicles Development (APUAVD), 175–178. https://doi.org/10.1109/apuavd64488.2024.10765890

- Prystavka, P., Chyrkov, A., Sorokopud, V., Kovtun, V. (2019). Automated Complex for Aerial Reconnaissance Tasks in Modern Armed Conflicts. CEUR Workshop Proceedings, 2588, 57–66.

- Prystavka, P., Cholyshkina, O., Dolgikh, S., Karpenko, D. (2020). Automated Object Recognition System based on Convolutional Autoencoder. 2020 10th International Conference on Advanced Computer Information Technologies (ACIT), 830–833. https://doi.org/10.1109/acit49673.2020.9208945

- Redmon, J., Farhadi, A. (2017). YOLO9000: Better, Faster, Stronger. 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 6517–6525. https://doi.org/10.1109/cvpr.2017.690

- Tian, Y., Wang, S., Li, E., Yang, G., Liang, Z., Tan, M. (2023). MD-YOLO: Multi-scale Dense YOLO for small target pest detection. Computers and Electronics in Agriculture, 213, 108233. https://doi.org/10.1016/j.compag.2023.108233

- Fedus, W., Zoph, B., Shazeer, N. (2022). Switch Transformers: Scaling to Trillion Parameter Models with Simple and Efficient Sparsity. Journal of Machine Learning Research, 23. https://doi.org/10.48550/arXiv.2101.03961

- Shaw, A., Hunter, D., Landola, F., Sidhu, S. (2019). SqueezeNAS: Fast Neural Architecture Search for Faster Semantic Segmentation. 2019 IEEE/CVF International Conference on Computer Vision Workshop (ICCVW), 2014–2024. https://doi.org/10.1109/iccvw.2019.00251

- Wu, B., Wan, A., Iandola, F., Jin, P. H., Keutzer, K. (2017). SqueezeDet: Unified, Small, Low Power Fully Convolutional Neural Networks for Real-Time Object Detection for Autonomous Driving. 2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops (CVPRW), 446–454. https://doi.org/10.1109/cvprw.2017.60

- Bello, I., Fedus, W., Du, X., Cubuk, E. D., Shlens, J., Zoph, B. et al. (2021). Revisiting ResNets: Improved Training and Scaling Strategies. Advances in Neural. Information Processing Systems, 27, 22614–22627. https://doi.org/10.48550/arXiv.2103.07579

- Tomasello, P., Sidhu, S., Shen, A., Moskewicz, M. W., Redmon, N., Joshi, G. et al. (2019). DSCnet: Replicating Lidar Point Clouds With Deep Sensor Cloning. 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW), 1317–1325. https://doi.org/10.1109/cvprw.2019.00171

- Qin, D., Leichner, C., Delakis, M., Fornoni, M., Luo, S., Yang, F. et al. (2024). MobileNetV4: Universal Models for the Mobile Ecosystem. Computer Vision – ECCV 2024, 78–96. https://doi.org/10.1007/978-3-031-73661-2_5

- Orange Pi 5 vs Raspberry Pi 4 Model B Rev 1.2. Available at: https://browser.geekbench.com/v5/cpu/compare/19357188?baseline=19357599&utm_source=chatgpt.com

- Zivakin, V., Kozachuk, O., Prystavka, P., Cholyshkina, O. (2022). Training set AERIAL SURVEY for Data Recognition Systems From Aerial Surveillance Cameras. CEUR Workshop Proceedings, 3347, 246–255.

##submission.downloads##

Опубліковано

Як цитувати

Номер

Розділ

Ліцензія

Авторське право (c) 2025 Pylyp Prystavka, Olha Cholyshkina, Valerii Zivakin, Borys Stetsenko

Ця робота ліцензується відповідно до Creative Commons Attribution 4.0 International License.

Закріплення та умови передачі авторських прав (ідентифікація авторства) здійснюється у Ліцензійному договорі. Зокрема, автори залишають за собою право на авторство свого рукопису та передають журналу право першої публікації цієї роботи на умовах ліцензії Creative Commons CC BY. При цьому вони мають право укладати самостійно додаткові угоди, що стосуються неексклюзивного поширення роботи у тому вигляді, в якому вона була опублікована цим журналом, але за умови збереження посилання на першу публікацію статті в цьому журналі.