Розробка гібридної моделі CNN-RNN для покращеного розпізнавання динамічних жестів у казахській жестовій мові

DOI:

https://doi.org/10.15587/1729-4061.2025.315834Ключові слова:

динамічне розпізнавання жестів, гібридна нейронна мережа, автоматизація Казахської жестової мови, мімікаАнотація

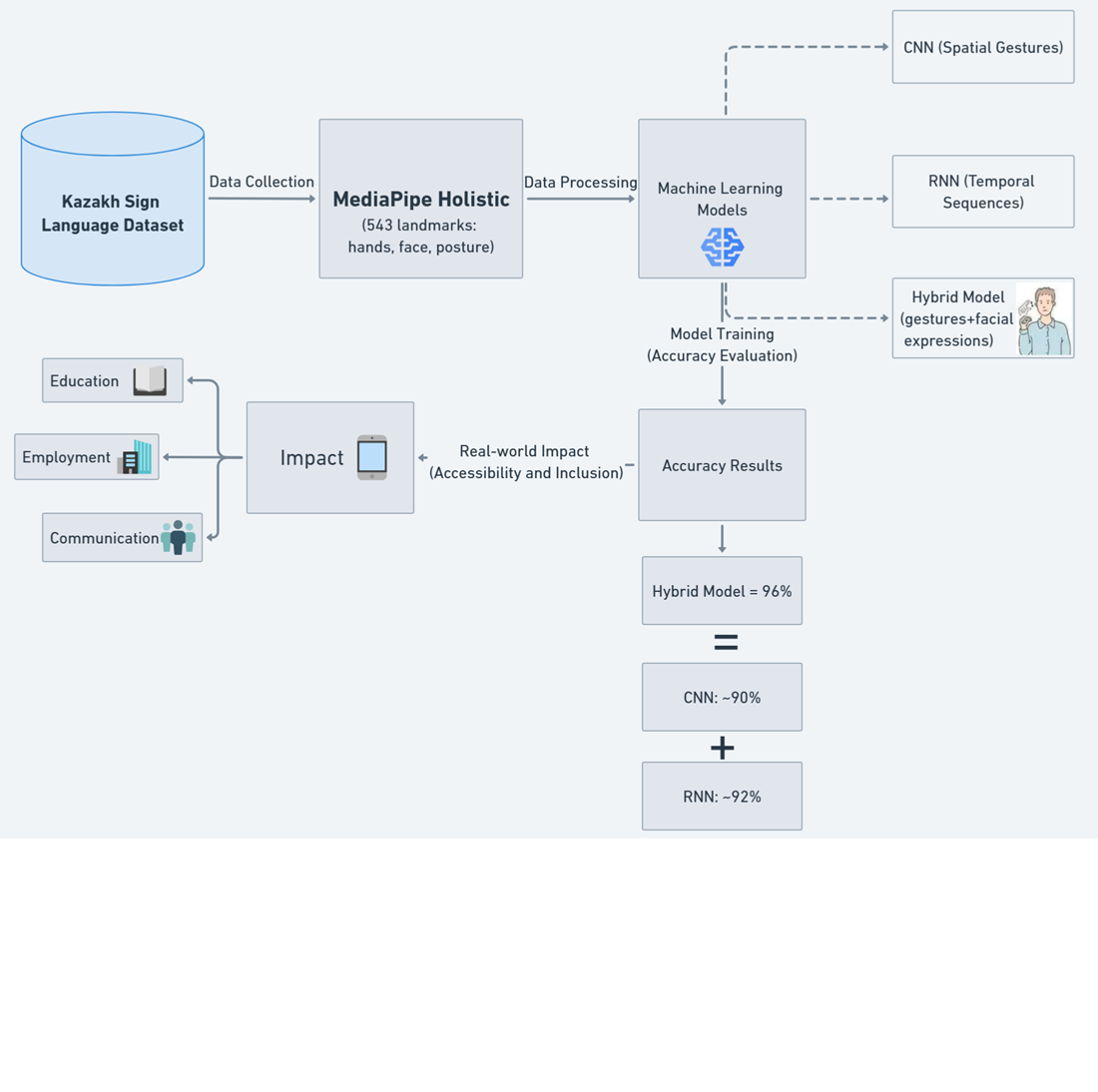

Для близько 1 % населення Республіки Казахстан, яке має порушення слуху, Казахська жестова мова набуває великого значення як засіб спілкування між громадянами держави. Обмеження інструментів для Казахської жестової мови (КЖМ) створюють значні виклики для людей із порушеннями слуху в освіті, працевлаштуванні та повсякденному житті, обмежуючи їх можливості для повноцінної участі в суспільному житті. Це дослідження вирішує ці проблеми через розробку автоматизованої системи розпізнавання жестів Казахської жестової мови, спрямованої на підвищення доступності та інклюзивності спілкування за допомогою штучного інтелекту. Підхід використовує передові методи машинного навчання, зокрема згорткові нейронні мережі (CNN) для розпізнавання просторових моделей жестів і рекурентні нейронні мережі (RNN) для обробки часових послідовностей. Об'єднавши ці методи, система розпізнає як жести рук, так і вирази обличчя, забезпечуючи двопотокову модель, яка перевершує однопотокові системи розпізнавання жестів, зосереджені лише на рухах рук. Для дослідження було створено спеціальний датасет за допомогою Mediapipe Holistic — інструмента з відкритим кодом, який визначає 543 ключові точки на руках, обличчі та позах, точно і надійно охоплюючи багатогранну природу жестової мови. Результати показали, що гібридна модель значно перевершує окремі моделі CNN та RNN, досягаючи точності до 96 %. Це свідчить, що інтеграція виразів обличчя з жестами рук значно підвищує точність розпізнавання жестової мови. Ця система має величезний потенціал для покращення інклюзивності, доступності та якості спілкування в різних сферах Республіки Казахстан, сприяючи ефективному спілкуванню людей із порушеннями слуху та відкриваючи широкі можливості для розширення досліджень і застосувань в інших жестових мовах

Посилання

- In Almaty, more than 10,000 people live with hearing disabilities (2022). Vecher.kz. Available at: https://vecher.kz/ru/article/v-almaty-projivaiut-bolee-10-tysiach-liudei-imeiushih-invalidnost-po-sluhu.html

- People with hearing disabilities find it difficult to obtain a profession (2024). 24KZ. Available at: https://24.kz/ru/news/social/item/675566-lyudyam-s-invalidnostyu-po-slukhu-slozhno-poluchit-professiyu

- On the demographic situation for January-September 2024 (2024). Statistical Committee of the Ministry of National Economy of the Republic of Kazakhstan. Available at: https://stat.gov.kz/ru/news/o-demograficheskoy-situatsii-za-yanvar-sentyabr-2024-goda/

- Ibadullaeva, A. (2023). Guides from the World of Silence: How Sign Language Interpreters Work in Kazakhstan. Liter.kz. Available at: https://liter.kz/provodniki-iz-mira-tishiny-kak-rabotaiut-surdoperevodchiki-v-kazakhstane-1676962474/

- Cheh, E. (2024). Acute shortage of hearing impairment educators in East Kazakhstan. Ustinka LIVE. Available at: https://ustinka.kz/vko/97381.html

- Bora, J., Dehingia, S., Boruah, A., Chetia, A. A., Gogoi, D. (2023). Real-time Assamese Sign Language Recognition using MediaPipe and Deep Learning. Procedia Computer Science, 218, 1384–1393. https://doi.org/10.1016/j.procs.2023.01.117

- Salau, A. O., Tamiru, N. K., Abeje, B. T. (2024). Derived Amharic alphabet sign language recognition using machine learning methods. Heliyon, 10 (19), e38265. https://doi.org/10.1016/j.heliyon.2024.e38265

- Katoch, S., Singh, V., Tiwary, U. S. (2022). Indian Sign Language recognition system using SURF with SVM and CNN. Array, 14, 100141. https://doi.org/10.1016/j.array.2022.100141

- Singh, D. K. (2021). 3D-CNN based Dynamic Gesture Recognition for Indian Sign Language Modeling. Procedia Computer Science, 189, 76–83. https://doi.org/10.1016/j.procs.2021.05.071

- Ibrahim, N. B., Selim, M. M., Zayed, H. H. (2018). An Automatic Arabic Sign Language Recognition System (ArSLRS). Journal of King Saud University - Computer and Information Sciences, 30 (4), 470–477. https://doi.org/10.1016/j.jksuci.2017.09.007

- Indra, D., Purnawansyah, Madenda, S., Wibowo, E. P. (2019). Indonesian Sign Language Recognition Based on Shape of Hand Gesture. Procedia Computer Science, 161, 74–81. https://doi.org/10.1016/j.procs.2019.11.101

- MediaPipe Holistic – Simultaneous Face, Hand and Pose Prediction, on Device (2020). Google Research Blog. Available at: https://research.google/blog/mediapipe-holistic-simultaneous-face-hand-and-pose-prediction-on-device/

- Chansri, C., Srinonchat, J. (2016). Hand Gesture Recognition for Thai Sign Language in Complex Background Using Fusion of Depth and Color Video. Procedia Computer Science, 86, 257–260. https://doi.org/10.1016/j.procs.2016.05.113

- Shin, J., Miah, A. S. M., Konnai, S., Takahashi, I., Hirooka, K. (2024). Hand gesture recognition using sEMG signals with a multi-stream time-varying feature enhancement approach. Scientific Reports, 14 (1). https://doi.org/10.1038/s41598-024-72996-7

- Papadimitriou, K., Sapountzaki, G., Vasilaki, K., Efthimiou, E., Fotinea, S.-E., Potamianos, G. (2024). A large corpus for the recognition of Greek Sign Language gestures. Computer Vision and Image Understanding, 249, 104212. https://doi.org/10.1016/j.cviu.2024.104212

- Shin, J., Hasan, Md. A. M., Miah, A. S. M., Suzuki, K., Hirooka, K. (2024). Japanese Sign Language Recognition by Combining Joint Skeleton-Based Handcrafted and Pixel-Based Deep Learning Features with Machine Learning Classification. Computer Modeling in Engineering & Sciences, 139 (3), 2605–2625. https://doi.org/10.32604/cmes.2023.046334

- Aitim, A., Satybaldiyeva, R. (2025). A comparison of Kazakh language processing models for improving semantic search results. Eastern-European Journal of Enterprise Technologies, 1 (2 (133)), 66–75. https://doi.org/10.15587/1729-4061.2025.315954

- Kenshimov, C., Buribayev, Z., Amirgaliyev, Y., Ataniyazova, A., Aitimov, A. (2021). Sign language dactyl recognition based on machine learning algorithms. Eastern-European Journal of Enterprise Technologies, 4 (2 (112)), 58–72. https://doi.org/10.15587/1729-4061.2021.239253

- Amirgaliyev, Y., Ataniyazova, A., Buribayev, Z., Zhassuzak, M., Urmashev, B., Cherikbayeva, L. (2024). Application of neural networks ensemble method for the Kazakh sign language recognition. Bulletin of Electrical Engineering and Informatics, 13 (5), 3275–3287. https://doi.org/10.11591/eei.v13i5.7803

- Dey, A., Biswas, S., Le, D.-N. (2024). Recognition of Wh-Question Sign Gestures in Video Streams using an Attention Driven C3D-BiLSTM Network. Procedia Computer Science, 235, 2920–2931. https://doi.org/10.1016/j.procs.2024.04.276

- Satybaldiyeva, R., Uskenbayeva, R., Moldagulova, A., Kalpeyeva, Z., Aitim, A. (2019). Features of Administrative and Management Processes Modeling. Optimization of Complex Systems: Theory, Models, Algorithms and Applications, 842–849. https://doi.org/10.1007/978-3-030-21803-4_84

- Athira, P. K., Sruthi, C. J., Lijiya, A. (2022). A Signer Independent Sign Language Recognition with Co-articulation Elimination from Live Videos: An Indian Scenario. Journal of King Saud University - Computer and Information Sciences, 34 (3), 771–781. https://doi.org/10.1016/j.jksuci.2019.05.002

- Rao, G. A., Kishore, P. V. V. (2018). Selfie video based continuous Indian sign language recognition system. Ain Shams Engineering Journal, 9 (4), 1929–1939. https://doi.org/10.1016/j.asej.2016.10.013

- Aitim, A. K., Satybaldiyeva, R. Zh., Wojcik, W. (2020). The construction of the Kazakh language thesauri in automatic word processing system. Proceedings of the 6th International Conference on Engineering & MIS 2020, 1–4. https://doi.org/10.1145/3410352.3410789

- Nuralin, M., Daineko, Y., Aljawarneh, S., Tsoy, D., Ipalakova, M. (2024). The real-time hand and object recognition for virtual interaction. PeerJ Computer Science, 10, e2110. https://doi.org/10.7717/peerj-cs.2110

- Kolesnikova, K., Mezentseva, O., Savielieva, O. (2019). Modeling of Decision Making Strategies In Management of Steelmaking Processes. 2019 IEEE International Conference on Advanced Trends in Information Theory (ATIT), 455–460. https://doi.org/10.1109/atit49449.2019.9030524

##submission.downloads##

Опубліковано

Як цитувати

Номер

Розділ

Ліцензія

Авторське право (c) 2025 Aigerim Aitim, Dariga Sattarkhuzhayeva, Aisulu Khairullayeva

Ця робота ліцензується відповідно до Creative Commons Attribution 4.0 International License.

Закріплення та умови передачі авторських прав (ідентифікація авторства) здійснюється у Ліцензійному договорі. Зокрема, автори залишають за собою право на авторство свого рукопису та передають журналу право першої публікації цієї роботи на умовах ліцензії Creative Commons CC BY. При цьому вони мають право укладати самостійно додаткові угоди, що стосуються неексклюзивного поширення роботи у тому вигляді, в якому вона була опублікована цим журналом, але за умови збереження посилання на першу публікацію статті в цьому журналі.

Ліцензійний договір – це документ, в якому автор гарантує, що володіє усіма авторськими правами на твір (рукопис, статтю, тощо).

Автори, підписуючи Ліцензійний договір з ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР», мають усі права на подальше використання свого твору за умови посилання на наше видання, в якому твір опублікований. Відповідно до умов Ліцензійного договору, Видавець ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР» не забирає ваші авторські права та отримує від авторів дозвіл на використання та розповсюдження публікації через світові наукові ресурси (власні електронні ресурси, наукометричні бази даних, репозитарії, бібліотеки тощо).

За відсутності підписаного Ліцензійного договору або за відсутністю вказаних в цьому договорі ідентифікаторів, що дають змогу ідентифікувати особу автора, редакція не має права працювати з рукописом.

Важливо пам’ятати, що існує і інший тип угоди між авторами та видавцями – коли авторські права передаються від авторів до видавця. В такому разі автори втрачають права власності на свій твір та не можуть його використовувати в будь-який спосіб.