Розробка автономної системи відстеження погляду для інклюзивної освіти

DOI:

https://doi.org/10.15587/1729-4061.2026.351773Ключові слова:

eye-tracking, інклюзивна освіта, рухові порушення, VR-шолом, доступність освіти, адаптивні технологіїАнотація

Об’єктом дослідження є технологія відстеження погляду (eye-tracking) як засіб забезпечення доступності освіти для осіб із тяжкими порушеннями опорно-рухового апарату. Натепер розроблено низку асистивних технологій, що мають значний освітній потенціал, але їх автономне застосування переважно пов’язане з такими труднощами, як залежність від нестабільності бездротових мереж чи зовнішніх обчислювальних ресурсів. Необхідність подолання технологічного розриву між можливостями асистивних технологій та їхньою реальною автономністю становить проблему, на розв’язання якої спрямована ця робота.

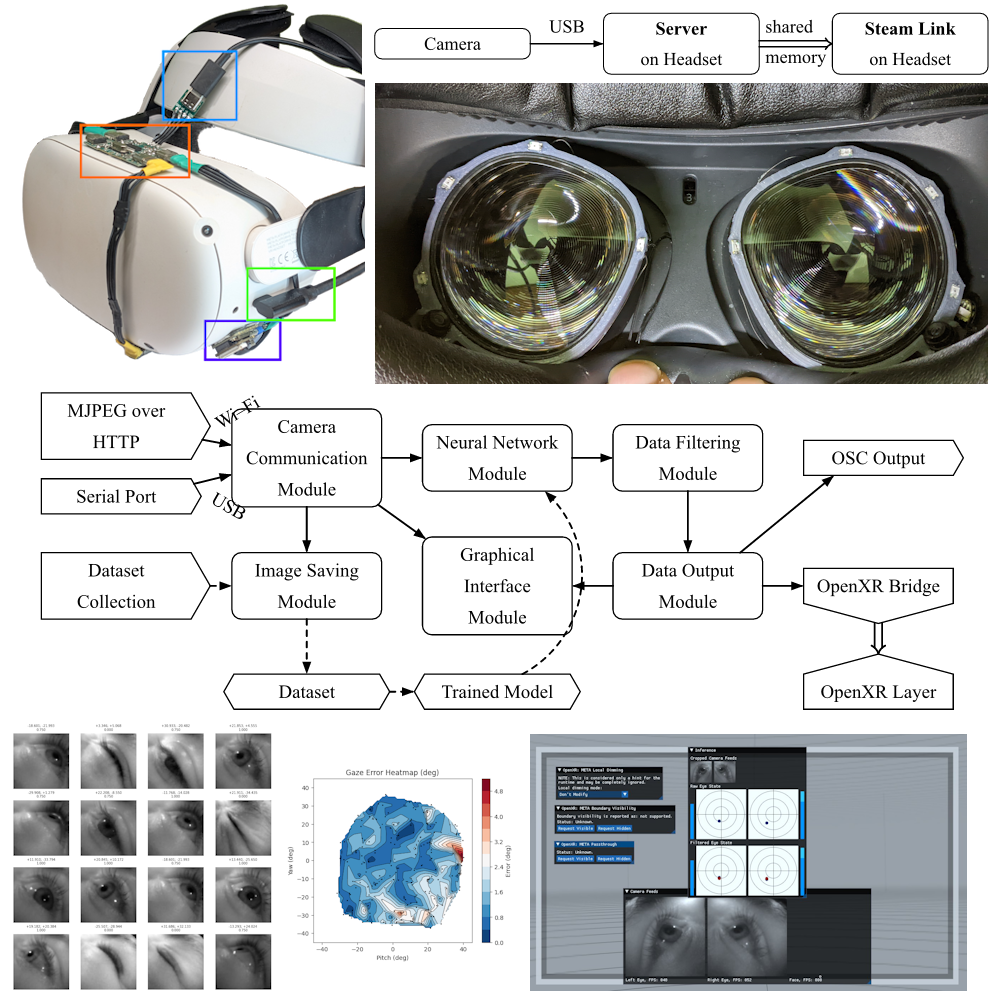

В результаті дослідження створена повністю автономна архітектура на базі VR (virtual reality) шоломів (Meta Quest), що забезпечує виконання всіх процесів обробки зображень очей та керування інтерфейсом безпосередньо з використанням процесора пристрою. Було вдосконалено апаратну частину (здійснені мініатюризація рамок, перехід на дротовий USB-інтерфейс), розроблено програмне забезпечення мовою Rust у форматі OpenXR API (Application Programming Interface) шару. Це дало можливість позбутися мережевих затримок і забезпечити роботу системи, стійку до будь-яких умов. Пряма взаємодія з апаратним забезпеченням шолома забезпечується ефективною оптимізацією згорткових нейронних мереж та використанням низькорівневих системних викликів. Створено імерсивний графічний інтерфейс користувача (GUI), який успішно протестований для налаштування та калібрування системи. GUI став доступним безпосередньо у віртуальному просторі шолома.

Одержані результати можуть знайти застосування в індивідуальному навчанні вдома, інклюзивних закладах освіти, реабілітаційних центрах, які організовують навчання осіб із тяжкими порушеннями опорно-рухового апарату

Посилання

- Nyström, M., Holmqvist, K. (2010). An adaptive algorithm for fixation, saccade, and glissade detection in eyetracking data. Behavior Research Methods, 42 (1), 188–204. https://doi.org/10.3758/brm.42.1.188

- Holmqvist, K., Nyström, M., Andersson, R., Dewhurst, R., Jarodzka, H., van de Weijer, J. (2011). Eye Tracking: A Comprehensive Guide to Methods and Measures. Oxford, 560.

- Kapp, S., Barz, M., Mukhametov, S., Sonntag, D., Kuhn, J. (2021). ARETT: Augmented Reality Eye Tracking Toolkit for Head Mounted Displays. Sensors, 21 (6), 2234. https://doi.org/10.3390/s21062234

- Holmqvist, K., Örbom, S. L., Hooge, I. T. C., Niehorster, D. C., Alexander, R. G., Andersson, R. et al. (2022). RETRACTED ARTICLE: Eye tracking: empirical foundations for a minimal reporting guideline. Behavior Research Methods, 55 (1), 364–416. https://doi.org/10.3758/s13428-021-01762-8

- Šmidekova, Z., Minarikova, E., Janík, M., Holmqvist, K. (2019). Using eye-tracking to investigate differences in teachers' professional vision IN action and ON action. Journal of Eye Movement Research, 12 (7), 260. Available at: https://openurl.ebsco.com/EPDB%3Agcd%3A7%3A10210567/detailv2?sid=ebsco%3Aplink%3Ascholar&id=ebsco%3Agcd%3A142777840&crl=c&link_origin=scholar.google.com

- Sim, G., Bond, R. (2021). Eye tracking in Child Computer Interaction: Challenges and opportunities. International Journal of Child-Computer Interaction, 30, 100345. https://doi.org/10.1016/j.ijcci.2021.100345

- El Moucary, C., Kassem, A., Rizk, D., Rizk, R., Sawan, S., Zakhem, W. (2024). A low-cost full-scale auto eye-tracking system for mobility-impaired patients. AEU - International Journal of Electronics and Communications, 174, 155023. https://doi.org/10.1016/j.aeue.2023.155023

- Sugianto, M., Zhou, Y., Qiu, J. (2025). Eye tracking-based dual task in rehabilitation of motor and cognitive function in post-stroke patients: a literature review. Bulletin of Faculty of Physical Therapy, 30 (1). https://doi.org/10.1186/s43161-025-00295-x

- Sunny, M. S. H., Zarif, M. I. I., Rulik, I., Sanjuan, J., Rahman, M. H., Ahamed, S. I. et al. (2021). Eye-gaze control of a wheelchair mounted 6DOF assistive robot for activities of daily living. Journal of NeuroEngineering and Rehabilitation, 18 (1). https://doi.org/10.1186/s12984-021-00969-2

- Bogachkov, Y., Uhan, P. (2025). Models of blended learning in the context of mixed processes. Information Technologies and Learning Tools, 107 (3), 239–260. https://doi.org/10.33407/itlt.v107i3.5920

- Batsenko, S., Bohachkov, Yu., Burov, O., Horbachenko, V., Korkishko, I., Lytvynova, S., Nosenko, Yu. ta in. (2025). Imersyvni tekhnolohiyi dlia pidtrymky zmishanoho navchannia v zakladakh zahalnoi serednoi osvity. Kyiv: ITsO NAPN Ukrainy, 174. Available at: https://lib.iitta.gov.ua/id/eprint/746953/1/ПОСІБНИК.pdf

- Sedinkin, O., Derkach, M., Skarga-Bandurova, I., Matiuk, D. (2024). Systema dlia vidstezhennia rukhu ochei na osnovi mashynnoho navchannia. Computer-integrated technologies: education, science, production, 55, 199–205. https://doi.org/10.36910/6775-2524-0560-2024-55-25

- Barkovska, O., Liapin, Y., Muzyka, T., Ryndyk, I., Botnar, P. (2024). Gaze direction monitoring model in computer system for academic performance assessment. Information Technologies and Learning Tools, 99 (1), 63–75. https://doi.org/10.33407/itlt.v99i1.5503

- Introducing Bigscreen Beyond 2 with next-gen optics and eyetracking. Available at: https://store.bigscreenvr.com/blogs/beyond/introducing-bigscreen-beyond-2

- My interview with Play For Dream about their headset, Android XR, enterprise licensing, China, and more! Available at: https://skarredghost.com/2025/06/05/play-for-dream-interview-android-xr/

- Vive Focus Vision Announced. Available at: https://www.uploadvr.com/vive-focus-vision-announced/

- Introducing Galaxy XR: Opening New Worlds. Available at: https://news.samsung.com/us/introducing-galaxy-xr-opening-new-worlds/

- Valve Officially Announces Steam Frame, A "Streaming-First" Standalone VR Headset. Available at: https://www.uploadvr.com/valve-steam-frame-official-announcement-features-details/

- Project-Babble/Baballonia. Available at: https://github.com/Project-Babble/Baballonia

- Geche, F., Mitsa, O., Mulesa, O., Horvat, P. (2022). Synthesis of a Two Cascade Neural Network for Time Series Forecasting. 2022 IEEE 3rd International Conference on System Analysis & Intelligent Computing (SAIC), 1–5. https://doi.org/10.1109/saic57818.2022.9922991

- Lupei, M., Shlahta, M., Mitsa, O., Horoshko, Y., Tsybko, H., Gorbachuk, V. (2022). Development of an Interactive Map Within the Implementation of Actual State and Public Directions. 2022 12th International Conference on Advanced Computer Information Technologies (ACIT). https://doi.org/10.1109/acit54803.2022.9913191

- Mitsa, O., Sharkan, V., Maksymchuk, V., Varha, S., Shkurko, H. (2023). Ethnocultural, Educational and Scientific Potential of the Interactive Dialects Map. 2023 IEEE International Conference on Smart Information Systems and Technologies (SIST), 226–231. https://doi.org/10.1109/sist58284.2023.10223544

##submission.downloads##

Опубліковано

Як цитувати

Номер

Розділ

Ліцензія

Авторське право (c) 2026 Andrii Symkin, Oleksandr Mitsa, Yurii Horoshko, Hanna Tsybko, Viktor Shakotko

Ця робота ліцензується відповідно до Creative Commons Attribution 4.0 International License.

Закріплення та умови передачі авторських прав (ідентифікація авторства) здійснюється у Ліцензійному договорі. Зокрема, автори залишають за собою право на авторство свого рукопису та передають журналу право першої публікації цієї роботи на умовах ліцензії Creative Commons CC BY. При цьому вони мають право укладати самостійно додаткові угоди, що стосуються неексклюзивного поширення роботи у тому вигляді, в якому вона була опублікована цим журналом, але за умови збереження посилання на першу публікацію статті в цьому журналі.

Ліцензійний договір – це документ, в якому автор гарантує, що володіє усіма авторськими правами на твір (рукопис, статтю, тощо).

Автори, підписуючи Ліцензійний договір з ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР», мають усі права на подальше використання свого твору за умови посилання на наше видання, в якому твір опублікований. Відповідно до умов Ліцензійного договору, Видавець ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР» не забирає ваші авторські права та отримує від авторів дозвіл на використання та розповсюдження публікації через світові наукові ресурси (власні електронні ресурси, наукометричні бази даних, репозитарії, бібліотеки тощо).

За відсутності підписаного Ліцензійного договору або за відсутністю вказаних в цьому договорі ідентифікаторів, що дають змогу ідентифікувати особу автора, редакція не має права працювати з рукописом.

Важливо пам’ятати, що існує і інший тип угоди між авторами та видавцями – коли авторські права передаються від авторів до видавця. В такому разі автори втрачають права власності на свій твір та не можуть його використовувати в будь-який спосіб.