MLP-KAN: реалізація шару Колмогорова-Арнольда у багатошаровому персептроні

DOI:

https://doi.org/10.15587/1729-4061.2025.328928Ключові слова:

багатошаровий персептрон, нейронна мережа, мережа Колмогорова-Арнольда, вагові коефіцієнти, радіально-базисні функціїАнотація

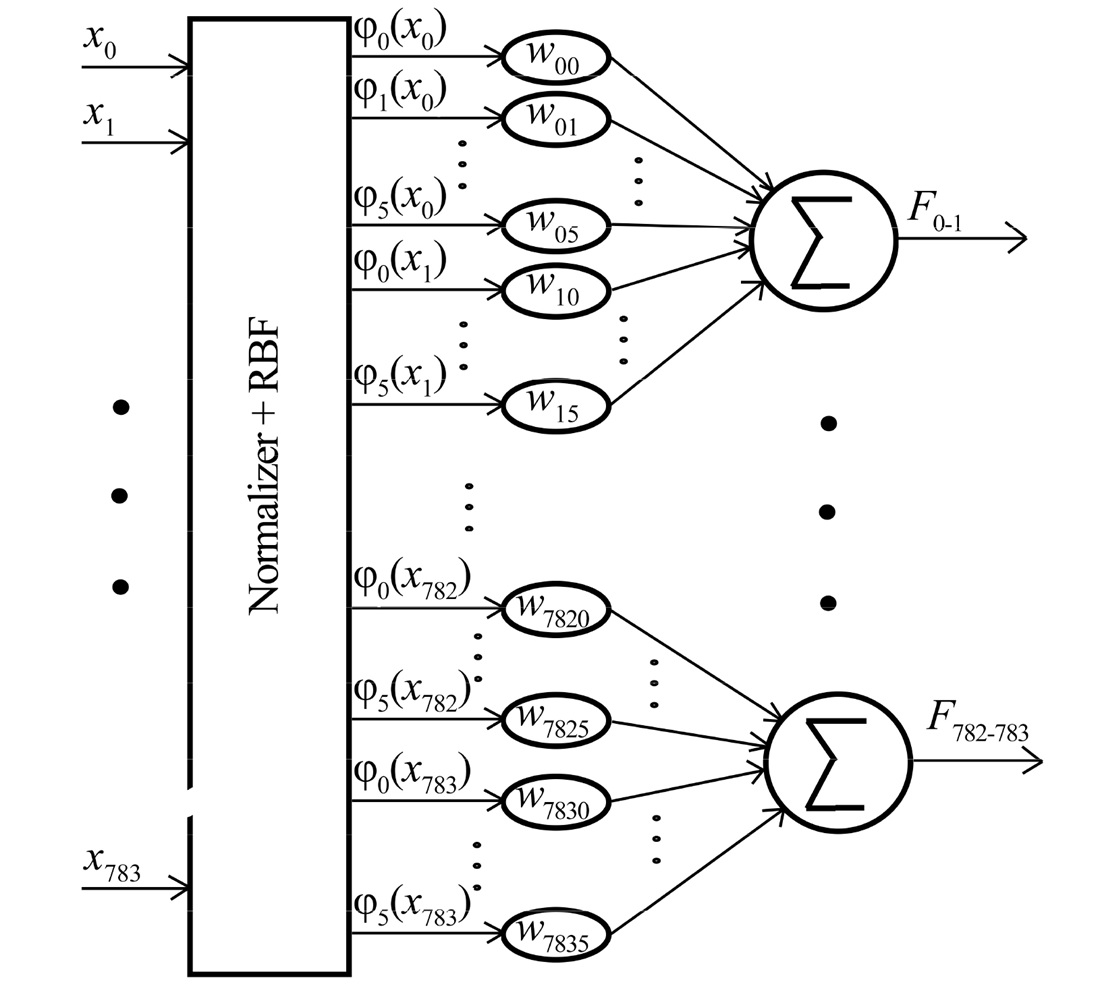

Об’єктом дослідження є нейронні мережі, які використовуються для класифікації об’єктів на зображеннях. Проблема, що вирішується в роботі, полягає у виявлення варіантів побудови архітектури багатошарового персептрона, що використовують шар Колмогорова-Арнольда та відрізняються найкращим співвідношенням якості класифікації та об’єму обчислень. У роботі запропоновано модифікацію багатошарового персептрона (MLP) за рахунок заміни першого прихованого шару на шар Колмогорова-Арнольда. Це дозволило одночасно використовувати апроксимуючі властивості нейронів і функцій активації, що навчаються. Особливістю розробленої нейронної мережі MLP-KAN на відміну від класичної мережі KAN є використання тільки однієї функції активації для кожного з вхідних елементів. Навчання функцій активації проводиться на основі незмінних радіальних базових функцій, які складаються з використанням вагових коефіцієнтів, що навчаються. Така побудова архітектури нейронної мережі MLP-KAN дозволила використовувати для її навчання типові бібліотеки та оптимізатори. При цьому, на відміну від відомих аналогів, немає уповільнення швидкості навчання. Проведені експериментальні дослідження на базі набору даних рукописних цифр (MNIST) показали, що MLP-KAN може забезпечувати більш високу якість класифікації за меншого обсягу обчислень. Зокрема, для отримання такої якості класифікації, як порівнювана MLP, при відповідному завданні параметрів MLP-KAN вимагає в 3,63 разів менший обсяг обчислень, ніж у MLP. Це дозволяє суттєво підвищити ефективність пристроїв класифікації об’єктів на зображеннях, побудованих на мікропроцесорах, що працюють в автономному режимі у складі роботизованих комплексів

Посилання

- Hornik, K., Stinchcombe, M., White, H. (1989). Multilayer feedforward networks are universal approximators. Neural Networks, 2 (5), 359–366. https://doi.org/10.1016/0893-6080(89)90020-8

- Liu, Z., Wang, Y., Vaidya, S., Ruehle, F., Halverson, J., Soljačić, M. et al. (2024). KAN: Kolmogorov-Arnold Networks. arXiv. https://doi.org/10.48550/arXiv.2404.19756

- Braun, J., Griebel, M. (2009). On a Constructive Proof of Kolmogorov’s Superposition Theorem. Constructive Approximation, 30 (3), 653–675. https://doi.org/10.1007/s00365-009-9054-2

- Guo, H., Li, F., Li, J., Liu, H. (2025). KAN v.s. MLP for Offline Reinforcement Learning. ICASSP 2025 - 2025 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), 1–5. https://doi.org/10.1109/icassp49660.2025.10888327

- Yu, R., Yu, W., Wang, X. (2024). KAN or MLP: A Fairer Comparison. arXiv. https://doi.org/10.48550/arXiv.2407.16674

- He, Y., Xie, Y., Yuan, Z., Sun, L. (2024). MLP-KAN: Unifying Deep Representation and Function Learning. arXiv. https://doi.org/10.48550/arXiv.2410.03027

- Xu, K., Chen, L., Wang, S. (2024). Kolmogorov-Arnold Networks for Time Series: Bridging Predictive Power and Interpretability. arXiv. https://doi.org/10.48550/arXiv.2406.02496

- Gao, Y., Hu, Z., Chen, W.-A., Liu, M., Ruan, Y. (2025). A revolutionary neural network architecture with interpretability and flexibility based on Kolmogorov–Arnold for solar radiation and temperature forecasting. Applied Energy, 378, 124844. https://doi.org/10.1016/j.apenergy.2024.124844

- Jamali, A., Roy, S. K., Hong, D., Lu, B., Ghamisi, P. (2024). How to Learn More? Exploring Kolmogorov-Arnold Networks for Hyperspectral Image Classification. Remote Sensing, 16 (21), 4015. https://doi.org/10.3390/rs16214015

- Roy, S. K., Krishna, G., Dubey, S. R., Chaudhuri, B. B. (2020). HybridSN: Exploring 3-D–2-D CNN Feature Hierarchy for Hyperspectral Image Classification. IEEE Geoscience and Remote Sensing Letters, 17 (2), 277–281. https://doi.org/10.1109/lgrs.2019.2918719

- Li, W., Li, L., Peng, M., Tao, R. (2025). KANDiff: Kolmogorov-Arnold Network and Diffusion Model-Based Network for Hyperspectral and Multispectral Image Fusion. Remote Sensing, 17 (1), 145. https://doi.org/10.3390/rs17010145

- Liu, X., Tang, Z., Wei, J. (2025). Multi-Layer Perceptron Model Integrating Multi-Head Attention and Gating Mechanism for Global Navigation Satellite System Positioning Error Estimation. Remote Sensing, 17 (2), 301. https://doi.org/10.3390/rs17020301

- Guo, L., Wang, Y., Guo, M., Zhou, X. (2024). YOLO-IRS: Infrared Ship Detection Algorithm Based on Self-Attention Mechanism and KAN in Complex Marine Background. Remote Sensing, 17 (1), 20. https://doi.org/10.3390/rs17010020

- Abd Elaziz, M., Ahmed Fares, I., Aseeri, A. O. (2024). CKAN: Convolutional Kolmogorov-Arnold Networks Model for Intrusion Detection in IoT Environment. IEEE Access, 12, 134837–134851. https://doi.org/10.1109/access.2024.3462297

- Bodner, A. D., Tepsich, A. S., Spolski, J. N., Pourteau, S. (2024). Convolutional Kolmogorov-Arnold Networks. arXiv. https://doi.org/10.48550/arXiv.2406.13155

- Drokin, I. (2024). Kolmogorov-Arnold Convolutions: Design Principles and Empirical Studies. arXiv. https://doi.org/10.48550/arXiv.2407.01092

- Cheon, M. (2024). Demonstrating the Efficacy of Kolmogorov-Arnold Networks in Vision Tasks. arXiv. https://doi.org/10.48550/arXiv.2406.14916

- Wang, C., Zhang, X., Liu, L. (2025). FloodKAN: Integrating Kolmogorov-Arnold Networks for Efficient Flood Extent Extraction. Remote Sensing, 17 (4), 564. https://doi.org/10.3390/rs17040564

- Seydi, S. T. (2024). Exploring the Potential of Polynomial Basis Functions in Kolmogorov-Arnold Networks: A Comparative Study of Different Groups of Polynomials. arXiv. https://doi.org/10.48550/arXiv.2406.02583

- Ismayilova, A., Ismayilov, M. (2023). On the universal approximation property of radial basis function neural networks. Annals of Mathematics and Artificial Intelligence, 92 (3), 691–701. https://doi.org/10.1007/s10472-023-09901-x

- He, Z.-R., Lin, Y.-T., Lee, S.-J., Wu, C.-H. (2018). A RBF Network Approach for Function Approximation. 2018 IEEE International Conference on Information and Automation (ICIA), 105–109. https://doi.org/10.1109/icinfa.2018.8812435

- Panda, S., Panda, G. (2022). On the Development and Performance Evaluation of Improved Radial Basis Function Neural Networks. IEEE Transactions on Systems, Man, and Cybernetics: Systems, 52 (6), 3873–3884. https://doi.org/10.1109/tsmc.2021.3076747

- Seghouane, A.-K., Shokouhi, N. (2021). Adaptive Learning for Robust Radial Basis Function Networks. IEEE Transactions on Cybernetics, 51 (5), 2847–2856. https://doi.org/10.1109/tcyb.2019.2951811

- Wu, C., Kong, X., Yang, Z. (2018). An Online Self-Adaption Learning Algorithm for Hyper Basis Function Neural Network. 2018 2nd IEEE Advanced Information Management,Communicates,Electronic and Automation Control Conference (IMCEC), 215–220. https://doi.org/10.1109/imcec.2018.8469684

- Galchonkov, O., Baranov, O., Antoshchuk, S., Maslov, O., Babych, M. (2024). Development of a neural network with a layer of trainable activation functions for the second stage of the ensemble classifier with stacking. Eastern-European Journal of Enterprise Technologies, 5 (9 (131)), 6–13. https://doi.org/10.15587/1729-4061.2024.311778

- LeCun, Y., Cortes, C. and Burges, C. J. C. (1998). The MNIST Database of Handwritten Digits. New York.

- MLP-KAN. Available at: https://github.com/oleksii-m-baranov/MLP-KAN

##submission.downloads##

Опубліковано

Як цитувати

Номер

Розділ

Ліцензія

Авторське право (c) 2025 Oleg Galchonkov, Oleksii Baranov, Oleh Maslov, Mykola Babych, Illia Baskov

Ця робота ліцензується відповідно до Creative Commons Attribution 4.0 International License.

Закріплення та умови передачі авторських прав (ідентифікація авторства) здійснюється у Ліцензійному договорі. Зокрема, автори залишають за собою право на авторство свого рукопису та передають журналу право першої публікації цієї роботи на умовах ліцензії Creative Commons CC BY. При цьому вони мають право укладати самостійно додаткові угоди, що стосуються неексклюзивного поширення роботи у тому вигляді, в якому вона була опублікована цим журналом, але за умови збереження посилання на першу публікацію статті в цьому журналі.

Ліцензійний договір – це документ, в якому автор гарантує, що володіє усіма авторськими правами на твір (рукопис, статтю, тощо).

Автори, підписуючи Ліцензійний договір з ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР», мають усі права на подальше використання свого твору за умови посилання на наше видання, в якому твір опублікований. Відповідно до умов Ліцензійного договору, Видавець ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР» не забирає ваші авторські права та отримує від авторів дозвіл на використання та розповсюдження публікації через світові наукові ресурси (власні електронні ресурси, наукометричні бази даних, репозитарії, бібліотеки тощо).

За відсутності підписаного Ліцензійного договору або за відсутністю вказаних в цьому договорі ідентифікаторів, що дають змогу ідентифікувати особу автора, редакція не має права працювати з рукописом.

Важливо пам’ятати, що існує і інший тип угоди між авторами та видавцями – коли авторські права передаються від авторів до видавця. В такому разі автори втрачають права власності на свій твір та не можуть його використовувати в будь-який спосіб.