Визначення інваріанту міжкадрової обробки для побудови метрики схожості зображень

DOI:

https://doi.org/10.15587/1729-4061.2023.276650Ключові слова:

цифрове зображення, колірний атлас, геоінформаційний об'єкт, онтологія, міра, подібність, хеш-функція, диффеоморфізм, персистентні гомологіїАнотація

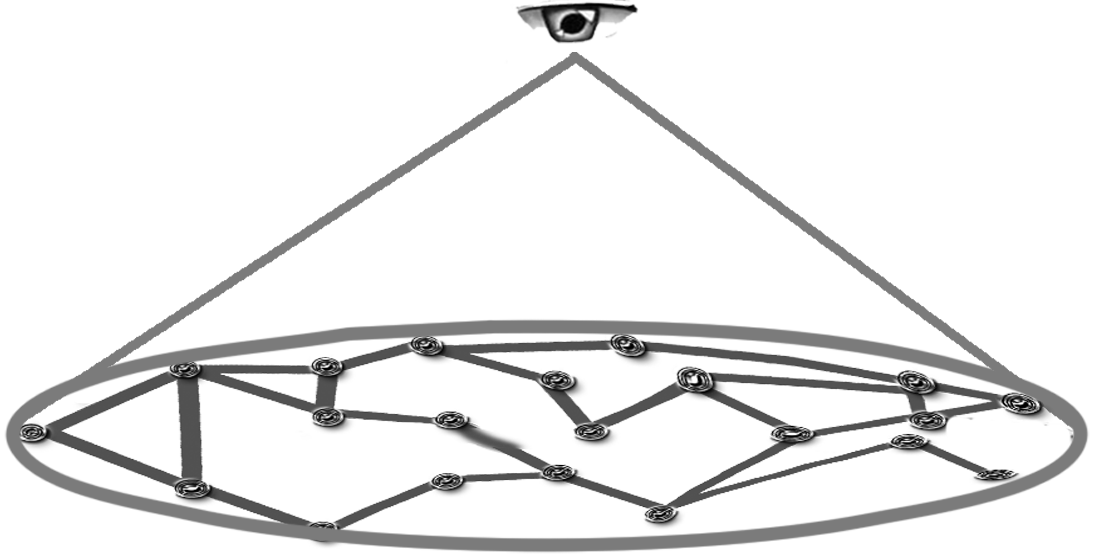

Актуальність моделювання цифрових зображень визначається необхідністю реалізації підходів у дослідженні завдань локалізації та ідентифікації об'єктів з метою зменшення обсягів даних. У роботі об'єктом дослідження є топологія дискретного двовимірного зображення у межах проблеми визначення інваріантів диффеоморфних перетворень. Під геоінформаційними об'єктами (ГІО) маються на увазі об'єкти, що знаходяться на заданій поверхні або об'єкти, що локально змінюють поверхню. Щодо об'єктів передбачається, що зміна їхньої геолокації в процесі формування як одиночних зображень, так і на протязі серії кадрів, отриманої в процесі незперервного моніторингу, є незначною. У процесі сканування поверхні враховуються можливі зміни положення джерела зображення, наприклад, такі як рискання, крен і тонгаж у разі безпілотних літальних апаратів (БПЛА). Ці маневри представляються як група диффеоморфізмів, які контролюються за рахунок внутрішніх гіроскопів несучого апарату та зовнішньої системи навігації. На підставі проведених досліджень визначено початкову онтологію цифрових зображень (ОЦЗ) з використанням моделі колірних просторів та функцій спеціального вигляду. Наявність онтології дозволяє побудувати адекватну топологію розподілу кольору зображення і враховувати специфіку розподілу різних кольорів на цифровому зображенні. Результати досліджень свідчать, що перспективним методом є визначення подібності за рахунок побудови графа структури колірного атласу (ГСКА) на базі ОЦЗ та визначення інваріантів як фрагмента ГСКА, успадкованого всіма зображеннями послідовності. До сфери та умов практичного використання отриманого результату відноситься його застосування до аналізу зображень методами штучного інтелекту

Посилання

- Zhang, J., Li, W., Ogunbona, P., Xu, D. (2019). Recent Advances in Transfer Learning for Cross-dataset Visual Recognition: A Problem-oriented Perspective. ACM Computing Surveys, 52 (1), 1–38. doi: https://doi.org/10.1145/3291124

- Yuan, X., Shi, J., Gu, L. (2021). A review of deep learning methods for semantic segmentation of remote sensing imagery. Expert Systems with Applications, 169, 114417. doi: https://doi.org/10.1016/j.eswa.2020.114417

- Yasin, H. M., Ameen, S. Y. (2021). Review and Evaluation of End-to-End Video Compression with Deep-Learning. 2021 International Conference of Modern Trends in Information and Communication Technology Industry (MTICTI). doi: https://doi.org/10.1109/MTICTI53925.2021.9664790

- Fan, L., Zhang, T., Du, W. (2021). Optical-flow-based framework to boost video object detection performance with object enhancement. Expert Systems with Applications, 170, 114544. doi: https://doi.org/10.1016/j.eswa.2020.114544

- Xue, T., Chen, B., Wu, J., Wei, D., Freeman, W. T. (2019). Video Enhancement with Task-Oriented Flow. International Journal of Computer Vision, 127 (8), 1106–1125. doi: https://doi.org/10.1007/s11263-018-01144-2

- Que, Z., Lu, G., Xu, D. (2021). VoxelContext-Net: An Octree based Framework for Point Cloud Compression. 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). doi: https://doi.org/10.1109/cvpr46437.2021.00598

- Duan, L., Liu, J., Yang, W., Huang, T., Gao, W. (2020). Video Coding for Machines: A Paradigm of Collaborative Compression and Intelligent Analytics. IEEE Transactions on Image Processing, 29, 8680–8695. doi: https://doi.org/10.1109/tip.2020.3016485

- Lu, G., Cai, C., Zhang, X., Chen, L., Ouyang, W., Xu, D., Gao, Z. (2020). Content Adaptive and Error Propagation Aware Deep Video Compression. Lecture Notes in Computer Science, 456–472. doi: https://doi.org/10.1007/978-3-030-58536-5_27

- Ballé, J., Laparra, V., Simoncelli, E. P. (2017). End-to-end Optimized Image Compression. in Proc. Int. Conf. Learning Representations (ICLR). doi: https://doi.org/10.48550/arXiv.1611.01704

- Liu, D., Li, Y., Lin, J., Li, H., Wu, F. (2020). Deep Learning-Based Video Coding. ACM Computing Surveys, 53 (1), 1–35. doi: https://doi.org/10.1145/3368405

- Subramanian, N., Elharrouss, O., Al-Maadeed, S., Bouridane, A. (2021). Image Steganography: A Review of the Recent Advances. IEEE Access, 9, 23409–23423. doi: https://doi.org/10.1109/access.2021.3053998

- Hu, Y., Yang, W., Ma, Z., Liu, J. (2021). Learning End-to-End Lossy Image Compression: A Benchmark. IEEE Transactions on Pattern Analysis and Machine Intelligence. doi: https://doi.org/10.1109/tpami.2021.3065339

- Hu, Z., Lu, G., Xu, D. (2021). FVC: A New Framework towards Deep Video Compression in Feature Space. 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). doi: https://doi.org/10.1109/cvpr46437.2021.00155

- Horda, O. V. (2016). Construction of the color atlas for digital image of defects such as a “crack.” ScienceRise, 10 (2 (27)), 55–60. doi: https://doi.org/10.15587/2313-8416.2016.80791

- Horda, E. V., Mykhailenko, V. M. (2016). Struktura tsvetovoho atlasa tsyfrovoho yzobrazhenyia defekta typa "treshchyna ". Scientific discussion, 3, 58–60.

- Nazarenko, I., Dedov, O., Bernyk, I., Rogovskii, I., Bondarenko, A., Zapryvoda, A. et al. (2020). Determining the regions of stability in the motion regimes and parameters of vibratory machines for different technological purposes. Eastern-European Journal of Enterprise Technologies, 6 (7 (108)), 71–79. doi: https://doi.org/10.15587/1729-4061.2020.217747

- Gorda, E., Mihaylenko, V. (2017). Ontology of digital image of defects of type "crack" of objects of construction. Upravlinnia rozvytkom skladnykh system, 30, 142–145. Available at: http://urss.knuba.edu.ua/files/zbirnyk-30/21.pdf

- Serdyuk, A. A., Belyavskiy, L. S. (2018). Analiz veroyatnostno-geometricheskogo metoda opredeleniya mestopolozheniya dvizhuschikhsya obektov. Sovremennaya spetsial'naya tekhnika, 1 (52), 6–13.

- Wolfson, H. J., Rigoutsos, I. (1997). Geometric hashing: an overview. IEEE Computational Science and Engineering, 4 (4), 10–21. doi: https://doi.org/10.1109/99.641604

##submission.downloads##

Опубліковано

Як цитувати

Номер

Розділ

Ліцензія

Авторське право (c) 2023 Elena Gorda, Anatolii Serdiuk, Ivan Nazarenko

Ця робота ліцензується відповідно до Creative Commons Attribution 4.0 International License.

Закріплення та умови передачі авторських прав (ідентифікація авторства) здійснюється у Ліцензійному договорі. Зокрема, автори залишають за собою право на авторство свого рукопису та передають журналу право першої публікації цієї роботи на умовах ліцензії Creative Commons CC BY. При цьому вони мають право укладати самостійно додаткові угоди, що стосуються неексклюзивного поширення роботи у тому вигляді, в якому вона була опублікована цим журналом, але за умови збереження посилання на першу публікацію статті в цьому журналі.

Ліцензійний договір – це документ, в якому автор гарантує, що володіє усіма авторськими правами на твір (рукопис, статтю, тощо).

Автори, підписуючи Ліцензійний договір з ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР», мають усі права на подальше використання свого твору за умови посилання на наше видання, в якому твір опублікований. Відповідно до умов Ліцензійного договору, Видавець ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР» не забирає ваші авторські права та отримує від авторів дозвіл на використання та розповсюдження публікації через світові наукові ресурси (власні електронні ресурси, наукометричні бази даних, репозитарії, бібліотеки тощо).

За відсутності підписаного Ліцензійного договору або за відсутністю вказаних в цьому договорі ідентифікаторів, що дають змогу ідентифікувати особу автора, редакція не має права працювати з рукописом.

Важливо пам’ятати, що існує і інший тип угоди між авторами та видавцями – коли авторські права передаються від авторів до видавця. В такому разі автори втрачають права власності на свій твір та не можуть його використовувати в будь-який спосіб.