Виявлення змін на зображеннях сонара бокового огляду на основі глибоких нейронних мереж співставлення ознак

DOI:

https://doi.org/10.15587/1729-4061.2025.346940Ключові слова:

сонар бокового огляду, співставлення, комп’ютерний зір, глибоке навчання, виявлення змінАнотація

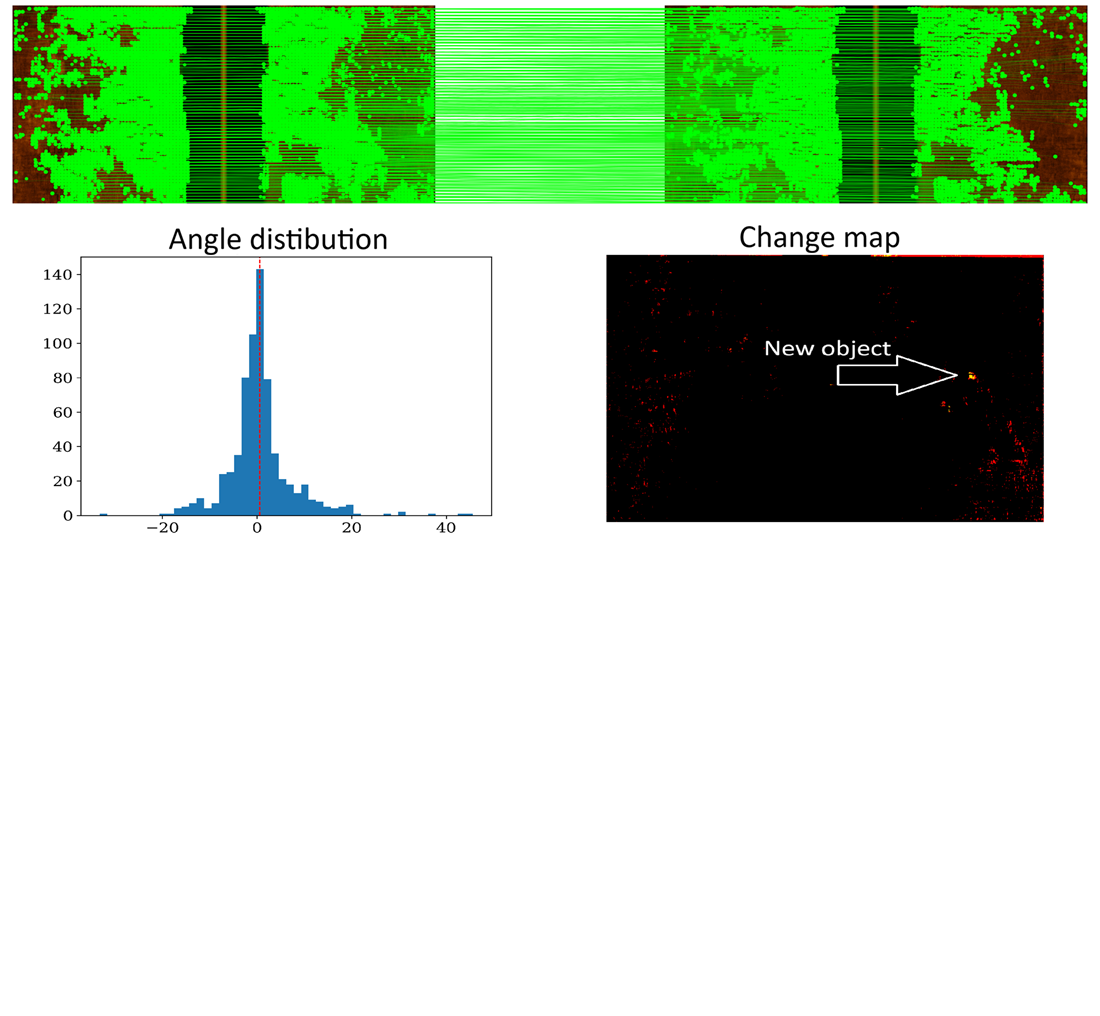

У роботі розглядається виявлення змін між повторними проходами на зображеннях сонара бокового огляду на основі співставлення ознак. Проблемою, що вирішувалася, є недостатня точність і стійкість співставлення у шумних і слабоконтрастних умовах морського дна. Було проведено систематичне експериментальне порівняння класичних, згорткових і трансформерних методів виявлення та співставлення ознак (SIFT, DISK, SuperPoint, LoFTR, LightGlue) на двох реальних наборах даних – Atlantic і Baltic. Кількісно та якісно оцінено виявлення та співставлення ключових точок; застосовано метрики зміщення, кутової стабільності та похибки репроєкції, а також оцінено ефективність використання ресурсів (час виконання, використання пам’яті). Всі методи продукували інтерпретовану карту змін на низькошумному наборі Baltic. На Atlantic така карта генерувалась епізодично. Комбінація SuperPoint + LightGlue показала найкращі результати відсотку коректних збігів після фільтрації RANSAC (43,4% та 65,6%) та середньої похибки репроєкції на обох наборах (36.0 та 3.9 пікс.). LoFTR показав найкраще покриття (до 97%) при відчутно більшому споживанні ресурсів. Ці результати пояснюються здатністю трансформерних архітектур враховувати глобальні просторові залежності, тоді як CNN-підходи є ефективнішими у зонах з вираженою локальною структурою та низьким шумом. Особливістю дослідження є застосування реальних зашумлених даних та порівняння найсучасніших методів співставлення у єдиному експериментальному середовищі. Це дозволяє підвищити надійність співставлення точок та виявлення змін у підводних місіях, моніторингу акваторій, протимінних заходах та автономної навігації. Результати можуть бути використані для подальшої адаптації моделей до акустичних зображень і інтелектуального аналізу акустичних даних

Посилання

- Zhou, X., Yuan, S., Yu, C., Li, H., Yuan, X. (2022). Performance Comparison of Feature Detectors on Various Layers of Underwater Acoustic Imagery. Journal of Marine Science and Engineering, 10 (11), 1601. https://doi.org/10.3390/jmse10111601

- Shafique, A., Cao, G., Khan, Z., Asad, M., Aslam, M. (2022). Deep Learning-Based Change Detection in Remote Sensing Images: A Review. Remote Sensing, 14 (4), 871. https://doi.org/10.3390/rs14040871

- Steiniger, Y., Schröder, S., Stoppe, J. (2022). Reducing the false alarm rate of a simple sidescan sonar change detection system using deep learning. 22nd International Symposium on Nonlinear Acoustics, 48, 070022. https://doi.org/10.1121/2.0001642

- Hedlund, W. (2024). Change Detection in Synthetic Aperture Sonar Imagery Using Segment Anything Model. Linköping University. Available at: https://www.diva-portal.org/smash/record.jsf?pid=diva2%3A1877741&dswid=6083

- Westman, E., Hinduja, A., Kaess, M. (2018). Feature-Based SLAM for Imaging Sonar with Under-Constrained Landmarks. 2018 IEEE International Conference on Robotics and Automation (ICRA), 3629–3636. https://doi.org/10.1109/icra.2018.8461004

- Alcantarilla, P., Nuevo, J., Bartoli, A. (2013). Fast Explicit Diffusion for Accelerated Features in Nonlinear Scale Spaces. Procedings of the British Machine Vision Conference 2013, 13.1-13.11. https://doi.org/10.5244/c.27.13

- Myers, V., Saebo, T. O., Hansen, R. (2018). Comparison of Co-Registration Techniques for Synthetic Aperture Sonar Images from Repeated Passes. Synthetic Aperture Sonar and Radar, 40 (2).

- Myers, V., Quidu, I., Zerr, B., Sabo, T. O., Hansen, R. E. (2020). Synthetic Aperture Sonar Track Registration With Motion Compensation for Coherent Change Detection. IEEE Journal of Oceanic Engineering, 45 (3), 1045–1062. https://doi.org/10.1109/joe.2019.2909960

- Zhou, X., Yu, C., Yuan, X., Luo, C. (2021). Matching Underwater Sonar Images by the Learned Descriptor Based on Style Transfer Method. Journal of Physics: Conference Series, 2029 (1), 012118. https://doi.org/10.1088/1742-6596/2029/1/012118

- Zhang, J., Xie, Y., Ling, L., Folkesson, J. (2023). A fully‐automatic side‐scan sonar simultaneous localization and mapping framework. IET Radar, Sonar & Navigation, 18 (5), 674–683. https://doi.org/10.1049/rsn2.12500

- Midtgaard, O., Hansen, R. E., Saebo, T. O., Myers, V., Dubberley, J. R., Quidu, I. (2011). Change detection using Synthetic Aperture Sonar: Preliminary results from the Larvik trial. OCEANS’11 MTS/IEEE KONA, 1–8. https://doi.org/10.23919/oceans.2011.6107272

- G-Michael, T., Marchand, B., Tucker, J. D., Marston, T. M., Sternlicht, D. D., Azimi-Sadjadi, M. R. (2016). Image-Based Automated Change Detection for Synthetic Aperture Sonar by Multistage Coregistration and Canonical Correlation Analysis. IEEE Journal of Oceanic Engineering, 1–21. https://doi.org/10.1109/joe.2015.2465631

- Gode, S., Hinduja, A., Kaess, M. (2024). SONIC: Sonar Image Correspondence using Pose Supervised Learning for Imaging Sonars. 2024 IEEE International Conference on Robotics and Automation (ICRA), 3766–3772. https://doi.org/10.1109/icra57147.2024.10611678

- Lindenberger, P., Sarlin, P.-E., Pollefeys, M. (2023). LightGlue: Local Feature Matching at Light Speed. 2023 IEEE/CVF International Conference on Computer Vision (ICCV), 17581–17592. https://doi.org/10.1109/iccv51070.2023.01616

- Barnes, C., Shechtman, E., Finkelstein, A., Goldman, D. B. (2009). PatchMatch. ACM Transactions on Graphics, 28 (3), 1–11. https://doi.org/10.1145/1531326.1531330

- Zhang, J., Xie, Y., Ling, L., Folkesson, J. (2025). A Dense Subframe-Based SLAM Framework With Side-Scan Sonar. IEEE Journal of Oceanic Engineering, 50 (2), 1087–1102. https://doi.org/10.1109/joe.2024.3503663

- Sun, J., Shen, Z., Wang, Y., Bao, H., Zhou, X. (2021). LoFTR: Detector-Free Local Feature Matching with Transformers. 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 8918–8927. https://doi.org/10.1109/cvpr46437.2021.00881

- DeTone, D., Malisiewicz, T., Rabinovich, A. (2018). SuperPoint: Self-Supervised Interest Point Detection and Description. 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW). https://doi.org/10.1109/cvprw.2018.00060

- Tyszkiewicz, M. J., Fua, P., Trulls, E. (2020). DISK: Learning local features with policy gradient. arXiv. http://doi.org/10.48550/ARXIV.2006.13566

- Culjak, I., Abram, D., Pribanic, T., Dzapo H., Cifrek, M. (2012). A brief introduction to OpenCV. 2012 Proceedings of the 35th International Convention MIPRO, 1725–1730. Available at: https://ieeexplore.ieee.org/document/6240859/authors#authors

- Gutiérrez, G., Torres-Avilés, R., Caniupán, M. (2024). cKdtree: a Compact Kdtree for Spatial Data. Alberto Mendelzon Workshop on Foundations of Data Management. Available at: https://www.semanticscholar.org/paper/cKdtree%3A-a-Compact-Kdtree-for-Spatial-Data-Guti%C3%A9rrez-Torres-Avil%C3%A9s/1106acf86126909ec2ad8ffa174cbd6e4dcca329

##submission.downloads##

Опубліковано

Як цитувати

Номер

Розділ

Ліцензія

Авторське право (c) 2025 Oleksandr Katrusha, Dmytro Prylipko, Kostiantyn Yefremov

Ця робота ліцензується відповідно до Creative Commons Attribution 4.0 International License.

Закріплення та умови передачі авторських прав (ідентифікація авторства) здійснюється у Ліцензійному договорі. Зокрема, автори залишають за собою право на авторство свого рукопису та передають журналу право першої публікації цієї роботи на умовах ліцензії Creative Commons CC BY. При цьому вони мають право укладати самостійно додаткові угоди, що стосуються неексклюзивного поширення роботи у тому вигляді, в якому вона була опублікована цим журналом, але за умови збереження посилання на першу публікацію статті в цьому журналі.

Ліцензійний договір – це документ, в якому автор гарантує, що володіє усіма авторськими правами на твір (рукопис, статтю, тощо).

Автори, підписуючи Ліцензійний договір з ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР», мають усі права на подальше використання свого твору за умови посилання на наше видання, в якому твір опублікований. Відповідно до умов Ліцензійного договору, Видавець ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР» не забирає ваші авторські права та отримує від авторів дозвіл на використання та розповсюдження публікації через світові наукові ресурси (власні електронні ресурси, наукометричні бази даних, репозитарії, бібліотеки тощо).

За відсутності підписаного Ліцензійного договору або за відсутністю вказаних в цьому договорі ідентифікаторів, що дають змогу ідентифікувати особу автора, редакція не має права працювати з рукописом.

Важливо пам’ятати, що існує і інший тип угоди між авторами та видавцями – коли авторські права передаються від авторів до видавця. В такому разі автори втрачають права власності на свій твір та не можуть його використовувати в будь-який спосіб.