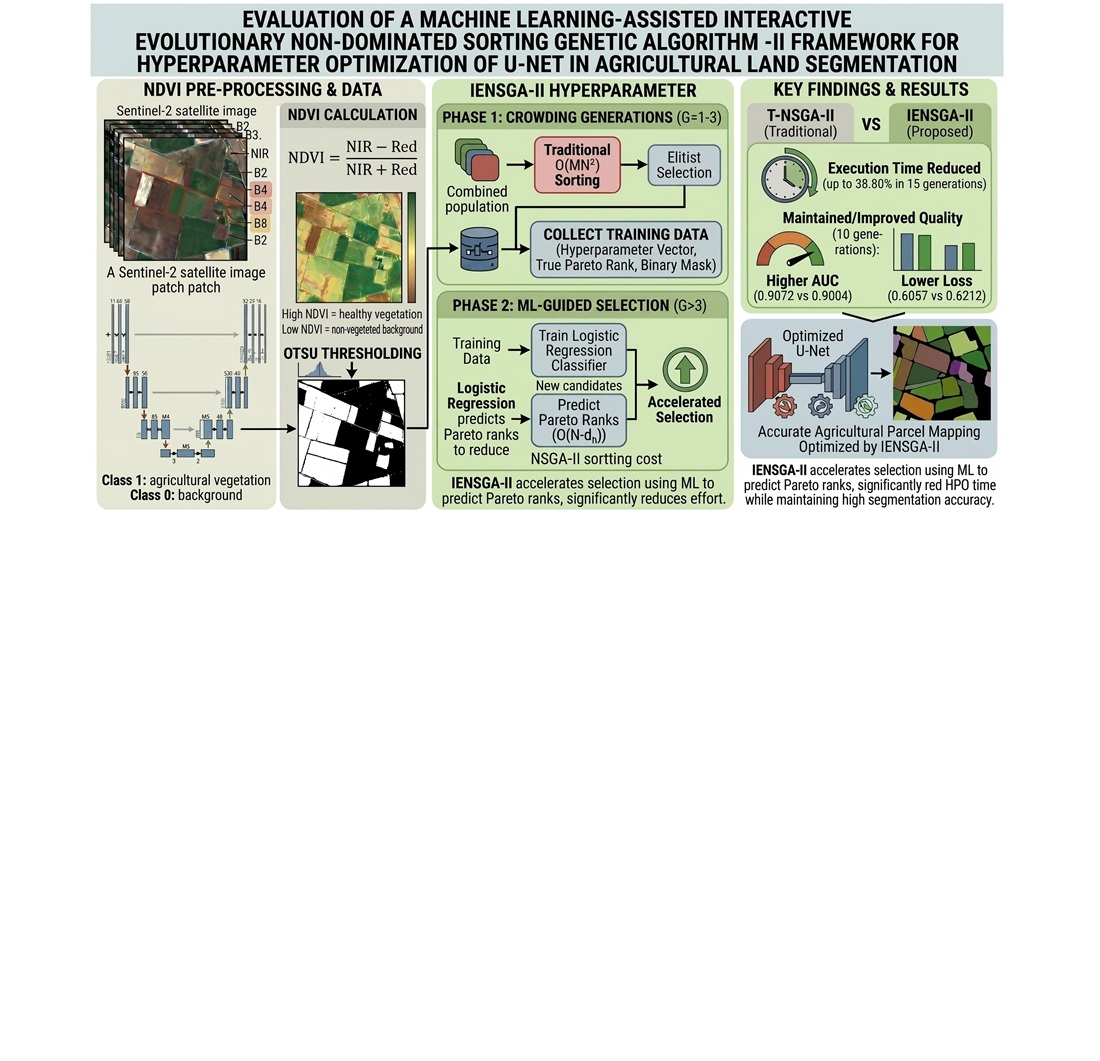

Оцінка фреймворку інтерактивного еволюційного недомінованого генетичного алгоритму сортування на основі машинного навчання для оптимізації гіперпараметрів U-Net у сегментації сільськогосподарських угідь

DOI:

https://doi.org/10.15587/1729-4061.2026.359143Ключові слова:

оптимізація гіперпараметрів, точне землеробство, сегментація U-Net, прогнозування рангу Парето, еволюція за допомогою сурогатних моделейАнотація

Об'єктом дослідження є конфігураційний простір гіперпараметрів архітектури U-Net для сегментації сільськогосподарських угідь за супутниковими знімками Sentinel-2. Проблема, що вирішується, полягає у надмірній вартості багатоцільової гіперпараметричної оптимізації, оскільки недоміноване сортування в недомінованому генетичному алгоритмі сортування II (NSGA-II) зі складністю O(MN2) стає вузьким місцем для моделей глибокої сегментації. Для вирішення цієї проблеми оцінюється фреймворк інтерактивного еволюційного недомінованого генетичного алгоритму сортування II (IENSGA-II), в якому класифікатор логістичної регресії навчається на векторах гіперпараметрів та рангах Парето з початкових поколінь NSGA-II, а потім використовується для прогнозування рангів у наступних поколіннях замість повного сортування. На відміну від існуючих підходів із використанням сурогатних методів, ця робота прогнозує ранги Парето без додаткових оцінок моделі. У бенчмарку Panoptic Agricultural Satellite Time Series (PASTIS) фреймворк скоротив час виконання на 20,07%, 16,39% та 38,80% для 5, 10 та 15 поколінь, а в умовах 10-поколінного періоду покращив критерії валідації, досягнувши площі під кривою робочих характеристик приймача (AUC) 0,9072 проти 0,9004 та втрати валідації 0,6057 проти 0,6212. Ці результати були досягнуті завдяки тому, що метод прискорює відбір, а не замінює оцінку моделі, тоді як розв'язання рівностей на основі AUC зберігає перевагу для більш точних рішень серед кандидатів з однаковим прогнозованим рангом. Ефективність випливає з регулярного зв'язку між гіперпараметрами та рангами Парето в ранніх еволюційних даних. На практиці метод використовується в обмеженому ресурсами багатоцільовому навчанні, коли початкові покоління забезпечують репрезентативні дані для прогнозування рангу

Посилання

- Zhu, X. X., Tuia, D., Mou, L., Xia, G.-S., Zhang, L., Xu, F., Fraundorfer, F. (2017). Deep Learning in Remote Sensing: A Comprehensive Review and List of Resources. IEEE Geoscience and Remote Sensing Magazine, 5 (4), 8–36. https://doi.org/10.1109/mgrs.2017.2762307

- Ronneberger, O., Fischer, P., Brox, T. (2015). U-Net: Convolutional Networks for Biomedical Image Segmentation. Medical Image Computing and Computer-Assisted Intervention – MICCAI 2015, 234–241. https://doi.org/10.1007/978-3-319-24574-4_28

- Bischl, B., Binder, M., Lang, M., Pielok, T., Richter, J., Coors, S., Thomas, J. et al. (2023). Hyperparameter optimization: Foundations, algorithms, best practices, and open challenges. WIREs Data Mining and Knowledge Discovery, 13 (2). https://doi.org/10.1002/widm.1484

- Deb, K., Pratap, A., Agarwal, S., Meyarivan, T. (2002). A fast and elitist multiobjective genetic algorithm: NSGA-II. IEEE Transactions on Evolutionary Computation, 6 (2), 182–197. https://doi.org/10.1109/4235.996017

- Goldberg, D. E. (1989). Genetic algorithms in search, optimization and machine learning. Addison-Wesley. Available at: https://dl.acm.org/doi/10.5555/534133

- Emmerich, M. T. M., Giannakoglou, K. C., Naujoks, B. (2006). Single- and multiobjective evolutionary optimization assisted by Gaussian random field metamodels. IEEE Transactions on Evolutionary Computation, 10 (4), 421–439. https://doi.org/10.1109/tevc.2005.859463

- Knowles, J. D., Corne, D. W. (2000). Approximating the Nondominated Front Using the Pareto Archived Evolution Strategy. Evolutionary Computation, 8 (2), 149–172. https://doi.org/10.1162/106365600568167

- Li, L., Jamieson, K., DeSalvo, G., Rostamizadeh, A., Talwalkar, A. (2017). Hyperband: a novel bandit-based approach to hyperparameter optimization. Journal of Machine Learning Research, 18. Available at: https://jmlr.org/papers/v18/16-558.html

- Gayibov, A., Gasimov, V. (2025). Interactive Evolutionary NSGA-II with Machine Learning for Efficient Hyperparameter Optimization of Convolutional Neural Networks. 2025 6th International Conference on Problems of Cybernetics and Informatics (PCI), 1–5. https://doi.org/10.1109/pci66488.2025.11219755

- Fare Garnot, V. S., Landrieu, L. (2021). Panoptic Segmentation of Satellite Image Time Series with Convolutional Temporal Attention Networks. 2021 IEEE/CVF International Conference on Computer Vision (ICCV), 4852–4861. https://doi.org/10.1109/iccv48922.2021.00483

- Pedregosa, F., Varoquaux, G., Gramfort, A. et al. (2011). Scikit-learn: machine learning in Python. Journal of Machine Learning Research, 12, 2825–2830. Available at: https://jmlr.org/papers/volume12/pedregosa11a/pedregosa11a.pdf

- Gayibov, A. (2025). Development of a zero-shot classification method for cross-regional crop mapping demonstrating domain transferability in Sentinel-2 imagery. Eastern-European Journal of Enterprise Technologies, 4 (2 (136)), 93–101. https://doi.org/10.15587/1729-4061.2025.338000

- Abadi, M., Barham, P., Chen, J., Chen, Z., Davis, A., Dean, J. et al. (2016). TensorFlow: a system for large-scale machine learning. In Proceedings of the 12th USENIX Symposium on Operating Systems Design and Implementation (OSDI). Available at: https://www.usenix.org/system/files/conference/osdi16/osdi16-abadi.pdf

- Gayibov, A., Gasimov, V. (2026). Extending spectral indices from multispectral satellite data using U-Net segmentation. Radioelectronic and Computer Systems, 1, 207–223. https://doi.org/10.32620/reks.2026.1.14

- Chen, X., Dong, X., Hsieh, C.-J., Huang, D., Le, Q. V., Liang, C. et al. (2023). Symbolic Discovery of Optimization Algorithms. Advances in Neural Information Processing Systems 36, 49205–49233. https://doi.org/10.52202/075280-2140

- O'Malley, T., Bursztein, E., Long, J., Chollet, F., Jin, H., Invernizzi, L. et al. (2019). KerasTuner. Available at: https://github.com/keras-team/keras-tuner

- Srinivas, N., Deb, K. (1994). Muiltiobjective Optimization Using Nondominated Sorting in Genetic Algorithms. Evolutionary Computation, 2 (3), 221–248. https://doi.org/10.1162/evco.1994.2.3.221

- Zitzler, E., Laumanns, M., Thiele, L. (2001). SPEA2: Improving the strength Pareto evolutionary algorithm. TIK-Report, 103. ETH Zurich. Available at: https://sop.tik.ee.ethz.ch/publicationListFiles/zlt2001a.pdf

- Hao, J., Yang, X., Wang, C., Tu, R., Zhang, T. (2022). An Improved NSGA-II Algorithm Based on Adaptive Weighting and Searching Strategy. Applied Sciences, 12 (22), 11573. https://doi.org/10.3390/app122211573

##submission.downloads##

Опубліковано

Як цитувати

Номер

Розділ

Ліцензія

Авторське право (c) 2026 Artughrul Gayibov, Vagif Gasimov, Esmira Mustafayeva, Kamala Aliyeva, Dilara Guluzada

Ця робота ліцензується відповідно до Creative Commons Attribution 4.0 International License.

Закріплення та умови передачі авторських прав (ідентифікація авторства) здійснюється у Ліцензійному договорі. Зокрема, автори залишають за собою право на авторство свого рукопису та передають журналу право першої публікації цієї роботи на умовах ліцензії Creative Commons CC BY. При цьому вони мають право укладати самостійно додаткові угоди, що стосуються неексклюзивного поширення роботи у тому вигляді, в якому вона була опублікована цим журналом, але за умови збереження посилання на першу публікацію статті в цьому журналі.

Ліцензійний договір – це документ, в якому автор гарантує, що володіє усіма авторськими правами на твір (рукопис, статтю, тощо).

Автори, підписуючи Ліцензійний договір з ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР», мають усі права на подальше використання свого твору за умови посилання на наше видання, в якому твір опублікований. Відповідно до умов Ліцензійного договору, Видавець ПП «ТЕХНОЛОГІЧНИЙ ЦЕНТР» не забирає ваші авторські права та отримує від авторів дозвіл на використання та розповсюдження публікації через світові наукові ресурси (власні електронні ресурси, наукометричні бази даних, репозитарії, бібліотеки тощо).

За відсутності підписаного Ліцензійного договору або за відсутністю вказаних в цьому договорі ідентифікаторів, що дають змогу ідентифікувати особу автора, редакція не має права працювати з рукописом.

Важливо пам’ятати, що існує і інший тип угоди між авторами та видавцями – коли авторські права передаються від авторів до видавця. В такому разі автори втрачають права власності на свій твір та не можуть його використовувати в будь-який спосіб.